从军事历史到未来战场:人工智能在目标识别与决策辅助系统中的革命与挑战

本文深入探讨人工智能技术在现代军事领域的核心应用——战场目标识别与指挥决策辅助系统。文章从军事历史演进的角度切入,分析AI如何重塑国家安全与军事装备的发展范式,系统阐述其技术现状、实战价值,并直面其在可靠性、伦理及国际规则层面所面临的严峻挑战,为理解智能化战争图景提供专业视角。

1. 军事历史的智慧与智能化转型的必然

纵观军事历史,从烽火台到卫星侦察,信息获取与处理能力的跃迁始终是决定战争胜负的关键。传统上,目标识别依赖侦察兵的经验与雷达、光学设备的性能,决策则高度依托指挥官的判断与参谋体系。然而,现代战场环境日益复杂,数据量呈指数级增长,传统模式已接近效能极限。在此背景下,人工智能的引入并非简单的技术叠加,而是一场深刻的军事革命。它旨在将指挥员从海量、冗余、高速的信息流中解放出来,聚焦于更高层级的战略与创造性决策。这不仅是军事装备的升级,更是对国家安全基石的重塑——谁能更高效地‘看见’、‘理解’并‘决断’,谁就能在未来的战略博弈中占据先机。因此,发展AI军事应用已成为世界主要大国维护国家安全的战略必选项。

2. 战场之眼:AI目标识别系统的现状与突破

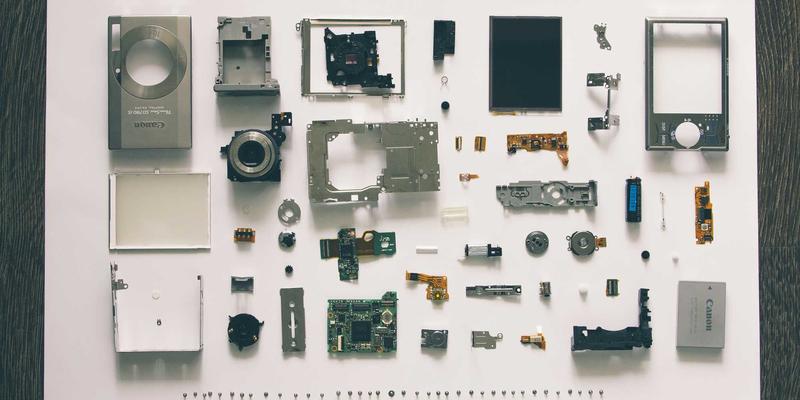

当前,AI在战场目标识别领域的应用已从实验室走向实战化测试阶段,成为新型军事装备的‘智慧内核’。其核心价值在于: 1. **超视距与全天候感知**:基于深度学习的图像识别算法,能够从卫星、无人机、地面传感器获取的多源影像(可见光、红外、合成孔径雷达)中,自动识别、分类并跟踪车辆、舰船、飞机、人员等目标,识别精度与速度远超传统方法,且不受黑夜、雾霾等条件限制。 2. **复杂环境下的强抗干扰能力**:通过对抗性训练,AI系统能够有效识别经过伪装、隐蔽或处于复杂城市环境中的目标,降低了被传统手段欺骗的概率。 3. **从识别到态势理解的演进**:先进的系统已不满足于‘是什么’,更追求‘在做什么’和‘可能做什么’。通过行为模式分析,AI能够判断部队的集结、补给线动向甚至作战意图,实现从静态目标识别到动态战场态势理解的跨越。 这些能力已集成于各类无人侦察平台、预警系统及单兵装备中,极大地扩展了战场的透明度和部队的感知边界。

3. 决策大脑:AI辅助指挥系统的赋能与局限

在指挥决策层面,AI扮演着‘超级参谋’的角色。其应用主要体现在: - **数据融合与态势生成**:实时融合来自情报、监视、侦察(ISR)系统及开源信息的数据,自动生成统一的、可理解的战场综合态势图,为指挥员提供一致的战场视图。 - **方案模拟与兵棋推演**:利用强化学习等技术,在极短时间内模拟成千上万种作战方案的可能结果,评估不同决策路径的风险与收益,为指挥员提供数据驱动的选项,而非单一建议。 - **后勤与资源优化**:智能化规划最优补给路线、装备维修调度及兵力部署,提升整体作战效率。 然而,AI决策辅助的核心原则仍是‘人在回路中’。系统提供分析、预测与选项,但最终的开火权、关键战略决断必须由人类指挥官负责。这既是对生命和伦理的尊重,也是应对AI‘黑箱’不确定性、避免被对手反向利用的必要措施。

4. 直面挑战:可靠性、伦理与规则博弈

人工智能在军事领域的征程并非坦途,其发展伴随着多重严峻挑战: 1. **技术可靠性与对抗脆弱性**:AI模型可能因训练数据偏差、罕见场景(长尾问题)或遭受专门的对抗性攻击(如精心设计的干扰图案)而出现误判,在高压的实战环境中,这种失误代价高昂。确保系统的鲁棒性、可解释性和抗干扰能力是首要技术难关。 2. **伦理与责任归属困境**:全自主武器系统(即‘杀手机器人’)引发了全球性的伦理与法律争议。核心问题在于:机器能否承担国际人道法中的区分原则(区分战斗员与平民)和相称性原则?攻击责任应由程序员、制造商还是指挥官承担?这迫切需要建立新的国际规范与法律框架。 3. **战略稳定性与军备竞赛风险**:AI军事化可能降低战争门槛,引发基于误判的冲突,或催生新的、更危险的军备竞赛。确保大国间的战略沟通,建立危机管控机制,防止AI技术颠覆现有的战略平衡,已成为关乎全球安全的重大议题。 结论而言,人工智能正在深刻改写军事历史的新篇章,重新定义国家安全的内涵与军事装备的形态。拥抱其革命性潜能与审慎应对其伴随的风险,将是各国军队、科技界与政策制定者必须共同解答的时代课题。未来的优势,属于那些能在技术创新与安全伦理之间找到最佳平衡点的智者。